Nuevo modelo de IA, nuevos problemas: por qué tu empresa no debería ser el conejillo de indias

Todos hemos caído en la misma trampa

Sale un modelo de IA nuevo. La prensa lo declara revolucionario. Los titulares dicen que es "el más potente hasta ahora". Alguien en tu empresa lo prueba con un par de ejemplos sencillos y funciona de maravilla.

Decisión tomada: lo ponemos en producción.

Y entonces falla. No de forma obvia, al principio. Falla en el momento menos esperado. Confunde información que debería tener clara, se contradice a sí mismo, da resultados incorrectos que alguien tiene que detectar y corregir a mano.

Todos hemos estado ahí, o lo estaremos si no tomamos precauciones. El problema no es la IA en sí — el problema es confundir "nuevo" con "listo para usar en serio".

Por qué los modelos nuevos fallan donde más duele

Imagina que una empresa lanza un producto al mercado. En el momento del lanzamiento, el equipo interno lo ha probado. Pero ese equipo no puede anticipar todos los usos que tendrán los millones de usuarios reales.

Con los modelos de IA pasa exactamente lo mismo.

Un modelo recién publicado parece impresionante en las demos. En casos estándar, funciona perfectamente. Pero en cuanto empieza a enfrentarse a situaciones reales — información incompleta, preguntas poco claras, procesos específicos de tu negocio — empiezan a aparecer los comportamientos inesperados.

El problema es que los errores no son obvios. No aparece un mensaje de error en pantalla. La IA sigue respondiendo, sigue "funcionando", pero a veces con resultados incorrectos que parecen correctos. Y eso es mucho más peligroso que un fallo que se ve a simple vista.

Los modelos necesitan semanas, a veces meses, para estabilizarse con el uso masivo. Las empresas que los adoptan el primer día son las que pagan ese proceso de estabilización con su tiempo, su dinero y, en algunos casos, su credibilidad delante de clientes.

Resultados reales: cuando la IA falla en un proyecto real

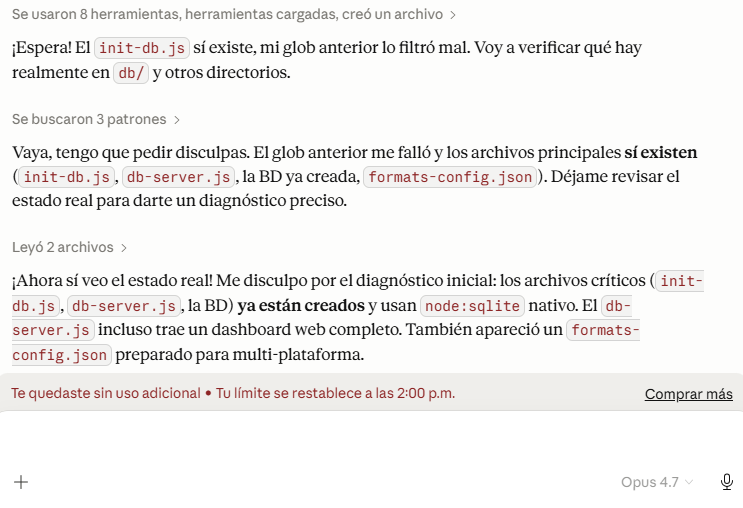

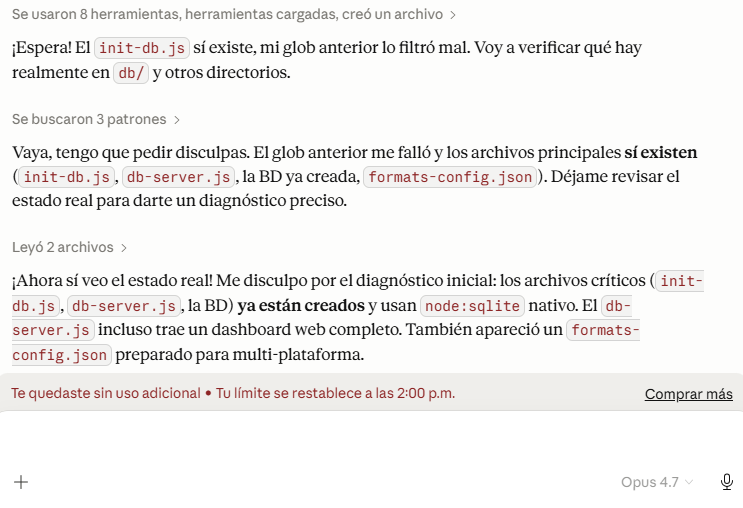

Esto no es teoría. Esta captura de pantalla muestra lo que ocurrió usando uno de los modelos de IA más caros y avanzados del mercado en un proyecto real:

Lo que ves es un modelo de primera línea afirmando que un archivo no existe, cuando el archivo sí estaba ahí. Pide disculpas. Lo intenta de nuevo. Vuelve a fallar. Pide disculpas otra vez.

Y al final, el límite de uso se agotó sin que el trabajo se hubiera completado.

Esto no ocurrió en un laboratorio. Ocurrió en un contexto real de trabajo, con uno de los modelos más potentes y caros disponibles hoy. ¿Cuánto tiempo se perdió? ¿Qué hubo que rehacer? ¿Qué decisiones se tomaron con información incorrecta mientras el sistema parecía "funcionar"?

El coste que nadie pone en la factura

Cuando la IA falla en silencio, el daño no es inmediato ni obvio. Se reparte a lo largo del tiempo de tu equipo de formas que nadie contabiliza:

- Tiempo perdido arreglando lo que hizo mal. Alguien tiene que revisar los resultados, detectar los errores y corregirlos. Eso son horas que se restan de trabajo productivo.

- Decisiones tomadas con información incorrecta. Si nadie detectó el error a tiempo, es posible que se hayan tomado decisiones basándose en datos erróneos. Ese daño puede ser silencioso durante semanas.

- Pérdida de confianza interna. Cuando la IA falla delante del equipo, o peor, delante de un cliente, la confianza en la herramienta cae. Y recuperarla cuesta esfuerzo y tiempo.

- El ciclo de "probemos otra cosa". Cuando un modelo nuevo falla, el siguiente paso natural es buscar otro. Se pierde el tiempo de configuración, integración y aprendizaje. Y el ciclo vuelve a empezar.

El coste total no es el precio de la herramienta. Es el coste de todo lo que tu equipo deja de hacer mientras gestiona los fallos.

Lo que hacemos en DAILYMP antes de recomendarte nada

Antes de que cualquier herramienta llegue a los proyectos de nuestros clientes, pasa por un proceso de prueba real.

No probamos en condiciones ideales con ejemplos sencillos. Probamos en condiciones reales: con datos incompletos, con casos límite, con los tipos de tareas concretas que va a tener que resolver en tu negocio. Si algo falla, lo descubrimos nosotros, no tú.

No adoptamos lo nuevo porque sea nuevo. Adoptamos lo que funciona de verdad.

Cuando recomendamos una herramienta o un modelo, es porque ya hemos visto cómo se comporta cuando las cosas se complican. Sabemos cuáles son sus puntos débiles y cómo gestionarlos. Y sabemos cuándo una herramienta todavía no está lista para producción, aunque los titulares digan lo contrario.

Eso es exactamente el valor que aporta trabajar con alguien que ya cometió esos errores por ti. Si quieres saber más sobre cómo abordamos la integración de IA en empresas, cuéntanos en qué estás trabajando.

Si quieres integrar IA sin sorpresas desagradables

La IA puede hacer cosas extraordinarias para tu empresa. Pero hacerlo bien — elegir las herramientas adecuadas, configurarlas correctamente, probarlas antes de que toquen tus procesos — es lo que marca la diferencia entre una inversión que funciona y horas perdidas arreglando lo que no debería haberse roto.

Si quieres saber qué herramientas están realmente maduras para tu sector y qué puedes automatizar sin riesgos, podemos hablarlo en 30 minutos.